无题

会议

-

CVPR是 IEEE Conference on Computer Vision and Pattern Recognition的缩写,即IEEE国际 计算机视觉 与 模式识别 会议。该会议是由IEEE举办的计算机视觉和模式识别领域的顶级会议。

-

Usenix Security Symposium (USENIX Security),是网络安全领域四大最高级别的国际学术会议之一,始于上世纪90年代初,曾经发表难度极高,近几年录取量才开始放开。USENIX Security是CCF推荐A类会议,Core Conference Ranking A*类会议,H-5指数80,Impact Score 13.04。USENIX Security录用的文章基本限于hardcore systems类型。

-

Transactions on Information Forensics & Security

-

DAC,全称 Proceedings of the ACM/EDAC/IEEE Design Automation Conference。DAC是以电子设计系统((EDA)、嵌入式系统及软件(ESS)和知识产权(IP)为主题的大会。DAC会议是集成电路设计界最顶级的会议,被誉为EDA界的奥斯卡,是全球领先的技术性大会和电子设计设计自动化商展。DAC是CCF 推荐A类会议,Core Conference Ranking推荐C类会议,H5 index为52,Impact Score 6.93

边松

研究方向:特定领域加速器、应用密码学、AI安全

论文

-

Song Bian, Weiwen Jiang, and Takashi Sato, Privacy-Preserving Medical Image Segmentation via Hybrid Trusted Execution Environment, ACM/IEEE Design Automation Conference (DAC), July 2021

通过混合可信执行环境保护隐私的医学图像分割

-

Song Bian, Weiwen Jiang, Qing Lu, Yiyu Shi, and Takashi Sato, NASS: Optimizing Secure Inference via Neural Architecture Search, in Proc. of European Conference on Artificial Intelligence (ECAI) (Virtual), June 2020.

-

Song Bian, Tianchen Wang, Masayuki Hiromoto, Yiyu Shi, and Takashi Sato, ENSEI: Efficient Secure Inference via Frequency-Domain Homomorphic Convolution for PrivacyPreserving Visual Recognition, in Proc. of IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) (Virtual), pp.9403-9412, June 2020

基于频域同态卷积的保密视觉识别的高效安全推理

方向

-

物联网双向认证

基于SRAM-PUF的物联网轻量级相互认证方案

-

(邓欣)Interpretable Multi-Modal Image Registration Network Based on Disentangled Convolutional Sparse Coding

==多模态图像匹配==

-

(边松)同态线性变换加速 APAS: Application-specific accelerators for RLWE-based homomorphic linear transformations

算法加速

-

==通过混合可信执行环境保护隐私的医学图像分割==

-

线上问诊个人信息隐写

-

AI对抗攻击的防御、视频检测、恶意内容检测

-

人工智能安全现状概析

在分析之前,我们首先来简单的介绍一下人工智能的应用。由于人工智能具有突出的数据分析、知识提取、自主学习等优点,被广泛应用在网络防护、数据管理、信息审查、智能安防、金融风控以及舆情监测等方面。在这些方面,往往存在若干安全风险,常见风险如下:

1.框架安全风险 |

近些年来,我们熟知的深度学习框架TensorFlow、Caffe等,及其依赖库被多次发现存在安全漏洞,这些漏洞可被攻击者利用,引发系统安全问题。

2.数据安全风险 |

攻击者可以通过网络的内部参数逆向获取网络训练的数据集;人工智能技术还会加强数据挖掘的能力,这加大了隐私泄露的风险,例如2018年3月的Facebook数据泄露事件。

3.算法安全风险 |

对于深度学习网络目标函数定义的不准确、不合理或者不正确也可能会导致错误甚至伤害性的结果。错误的目标函数、计算成本太高的目标函数、表达能力有限的网络都可能使网络产生错误的结果。例如,2018年3月,Uber自动驾驶汽车因机器视觉系统未及时识别路上突然出现的行人,导致与行人相撞,导致行人死亡的事故。

算法存在偏见与人工智能的不可解释性也是一个重大的问题。之前美国利用人工智能算法预测犯罪的人,名单暴露,其中许多无辜的人被冤枉,并且被冤枉的人中大多数为黑人,并且对于决策算法中系统为什么做出这样的决策,即使它的开发者也无法给出合理的解释。

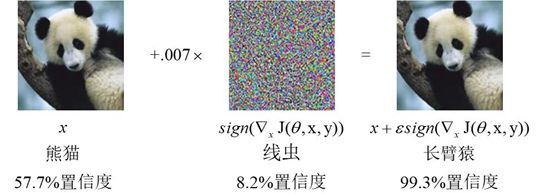

对抗性样本的出现也会使算法出现误判的情况,如下图中加入少量的噪声,AI便将熊猫以很高的置信度识别成长臂猿。

4.信息安全风险 |

只要有足够的训练数据,人工智能就可以制作虚假的信息,用于不法活动。例如AI换脸技术DeepFakes,还有前段时间出现的DeepNude。一些不法分子利用虚假的语音与视频来实施zhapian。目前谷歌发明的聊天机器人在与人进行电话聊天时,已经完全能骗过人类。